MCP là gì? Tìm hiểu Model Context Protocol cho AI hiện đại

Model Context Protocol là gì?

Model Context Protocol (MCP) là một giao thức mở nhằm chuẩn hóa cách các ứng dụng cung cấp ngữ cảnh cho các mô hình ngôn ngữ lớn. Hãy tưởng tượng MCP như một "cổng USB-C" cho các ứng dụng AI: giống như USB-C cho phép kết nối thiết bị với nhiều phụ kiện khác nhau theo cách thống nhất, MCP cung cấp một cách tiếp cận chuẩn hóa để liên kết các mô hình AI với dữ liệu bên ngoài, từ cơ sở dữ liệu, tệp tin, đến các API và công cụ.

MCP không phải là một thuật toán AI cụ thể mà là một giao thức trung gian, giúp đảm bảo ngữ cảnh được truyền tải một cách nhất quán, hiệu quả và an toàn giữa các thành phần trong hệ thống AI. Nó cho phép các LLM truy cập thông tin theo thời gian thực và thực hiện hành động mà không cần tích hợp tùy chỉnh phức tạp cho từng nguồn dữ liệu.

Ví dụ: Khi bạn yêu cầu một chatbot tìm kiếm thông tin trên web hoặc truy cập lịch làm việc của bạn, MCP đảm bảo rằng chatbot có thể kết nối với các nguồn dữ liệu này một cách liền mạch thông qua một giao thức chung.

MCP ra đời từ đâu?

MCP được phát triển bởi Anthropic, một công ty do các cựu nhân viên OpenAI thành lập, với sứ mệnh xây dựng AI an toàn và dễ hiểu. Được giới thiệu lần đầu vào tháng 11 năm 2024, MCP xuất phát từ nhu cầu giải quyết một thách thức cốt lõi trong ứng dụng LLM: kết nối chúng với dữ liệu thực tế một cách hiệu quả. Theo thông tin từ trang chính thức, Anthropic thiết kế MCP để thay thế các giải pháp tích hợp tùy chỉnh – vốn thường tốn thời gian và không đồng bộ – bằng một giao thức duy nhất, có thể tái sử dụng trên nhiều hệ thống.

Người đứng sau ý tưởng này là đội ngũ kỹ sư và nhà nghiên cứu tại Anthropic, với sự đóng góp quan trọng từ cộng đồng mã nguồn mở. MCP được lấy cảm hứng từ Language Server Protocol (LSP) – một giao thức chuẩn hóa cách các công cụ phát triển hỗ trợ ngôn ngữ lập trình. Tương tự, MCP hướng tới việc tạo ra một hệ sinh thái nơi các ứng dụng AI có thể dễ dàng tích hợp với dữ liệu và công cụ từ nhiều nguồn khác nhau.

Tại sao cần Model Context Protocol?

Các mô hình AI hiện đại, như GPT, Llama hay Claude của Anthropic, thường bị giới hạn bởi dữ liệu huấn luyện tĩnh. Để hoạt động hiệu quả trong thế giới thực, chúng cần truy cập thông tin mới nhất và tương tác với hệ thống bên ngoài. MCP giải quyết những thách thức sau:

- Quy mô ngữ cảnh lớn: Các LLM hiện nay có thể xử lý hàng triệu token ngữ cảnh, nhưng việc truyền tải lượng thông tin này đòi hỏi một cách tiếp cận hiệu quả để tránh lãng phí tài nguyên.

- Tính không đồng nhất: Mỗi ứng dụng AI thường yêu cầu định dạng ngữ cảnh riêng, gây khó khăn cho việc tích hợp. MCP cung cấp một chuẩn chung.

- Bảo mật và quyền riêng tư: MCP tích hợp cơ chế bảo mật để bảo vệ dữ liệu nhạy cảm trong quá trình truyền tải.

- Tối ưu hóa hiệu suất: MCP cho phép nén và ưu tiên ngữ cảnh, giảm thời gian xử lý và tăng tốc độ phản hồi.

Theo Anthropic, MCP đơn giản hóa việc phát triển bằng cách loại bỏ nhu cầu xây dựng tích hợp riêng lẻ cho từng nguồn dữ liệu, giúp các nhà phát triển tập trung vào việc tạo ra giá trị thay vì xử lý kỹ thuật phức tạp.

Cách hoạt động của Model Context Protocol

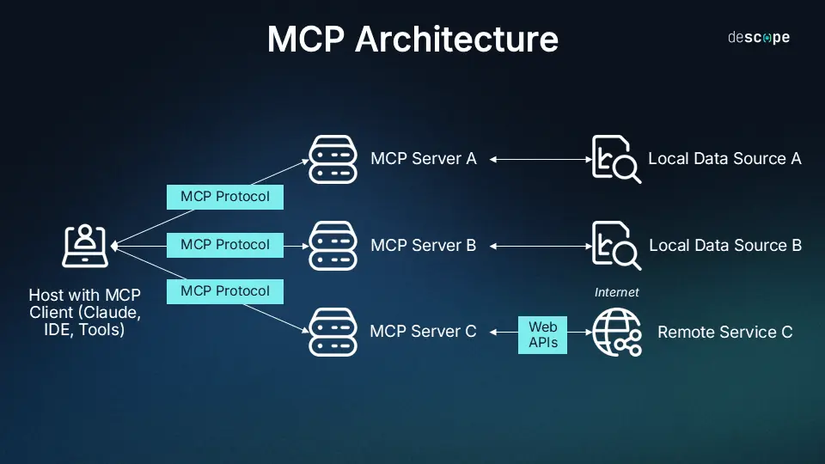

MCP hoạt động dựa trên kiến trúc client-server, trong đó:

MCP hoạt động dựa trên kiến trúc client-server, trong đó:

- Hosts: Là các ứng dụng LLM (như Claude Desktop hoặc IDE tích hợp AI) khởi tạo kết nối.

- Clients: Duy trì kết nối 1:1 với các server, nằm trong ứng dụng host.

- Servers: Cung cấp dữ liệu hoặc công cụ cho LLM thông qua MCP.

Các thành phần chính của MCP bao gồm:

- Cấu trúc dữ liệu ngữ cảnh: Chuẩn hóa thông tin như metadata (thông tin người dùng, thời gian), lịch sử hội thoại, yêu cầu hiện tại và các ràng buộc.

- Giao thức truyền tải: Sử dụng JSON-RPC qua STDIO hoặc Server-Sent Events (SSE) để trao đổi dữ liệu giữa client và server.

- Cơ chế nén và ưu tiên: Tối ưu hóa ngữ cảnh để giảm tải xử lý.

- Tích hợp bảo mật: Hỗ trợ mã hóa và xác thực để đảm bảo an toàn.

Quy trình cơ bản:

- Ứng dụng thu thập ngữ cảnh từ người dùng hoặc hệ thống.

- Ngữ cảnh được định dạng theo chuẩn MCP.

- Client gửi yêu cầu đến server qua giao thức MCP.

- Server xử lý và trả về dữ liệu hoặc thực hiện hành động.

- LLM sử dụng kết quả để đáp ứng người dùng, đồng thời cập nhật ngữ cảnh nếu cần.

Ứng dụng thực tiễn của MCP

MCP mở ra nhiều khả năng ứng dụng:

- Chatbot và trợ lý ảo: Kết nối với lịch làm việc, email hoặc công cụ tìm kiếm để cung cấp phản hồi chính xác hơn.

- Hệ thống đề xuất: Truy cập dữ liệu người dùng theo thời gian thực để cá nhân hóa gợi ý.

- Phát triển phần mềm: Tích hợp với IDE để hỗ trợ lập trình viên truy cập tài liệu hoặc cơ sở dữ liệu.

- Doanh nghiệp: Tự động hóa quy trình bằng cách liên kết AI với hệ thống CRM, ERP hoặc kho dữ liệu.

Ví dụ từ trang chính thức: MCP cho phép một LLM như Claude truy cập cơ sở dữ liệu SQLite cục bộ để thực hiện truy vấn, hoặc sử dụng API tìm kiếm như Brave Search để lấy thông tin mới nhất từ web.

So sánh MCP và API truyền thống

| Tiêu chí | MCP | API truyền thống |

| Kiến trúc giao tiếp | Hai chiều, giữ trạng thái (stateful) | Một chiều, không trạng thái (stateless) |

| Tiêu chuẩn tích hợp | Một giao thức thống nhất | Mỗi API một tích hợp riêng biệt |

| Khả năng khám phá động | Tự động phát hiện công cụ, dịch vụ | Không, phải cấu hình thủ công |

| Loại dữ liệu hỗ trợ | Dữ liệu cấu trúc, phi cấu trúc, prompt, tool | Đa dạng nhưng phụ thuộc từng API |

| Phản hồi theo thời gian thực | Có | Hiếm |

| Quản lý ngữ cảnh | Tích hợp giữa ngữ cảnh, luồng hội thoại | Không duy trì ngữ cảnh giữa các lần gọi |

| Mở rộng và bảo trì | Dễ dàng, chỉ cần thêm server mới | Khó khăn, phải sửa/tạo lại từng tích hợp |

| Độ trễ và hiệu năng | Độ trễ thấp, tối ưu cho AI | Có thể cao, kém tối ưu cho AI phức tạp |

| Bảo mật và kiểm soát | Quản lý quyền tập trung, nhất quán | Tùy theo từng API |

| Độ trưởng thành công nghệ | Mới, tập trung cho AI | Đã trưởng thành, nhiều mẫu và tài liệu |

| Phù hợp với AI/LLM | Rất phù hợp, chuẩn hóa cho AI | Chỉ phù hợp với tích hợp cố định, đơn nhiệm |

| Quản lý tài nguyên | Tối ưu theo phiên AI, hỗ trợ lưu trữ ngữ cảnh | Chuẩn HTTP cơ bản, không chuyên cho AI |

Tương lai của Model Context Protocol

MCP vẫn đang phát triển, nhưng với sự hậu thuẫn của Anthropic và cộng đồng mã nguồn mở, nó có tiềm năng trở thành tiêu chuẩn toàn cầu. Một số hướng đi trong tương lai:

- Chuẩn hóa rộng rãi: Được các tổ chức như IEEE chấp nhận.

- Hỗ trợ đa phương thức: Quản lý ngữ cảnh từ văn bản, hình ảnh, âm thanh.

- Tích hợp sâu hơn: Kết hợp với các công nghệ như blockchain để tăng cường bảo mật.

Anthropic cũng đang phát triển các SDK (TypeScript, Python, Java, v.v.) và dự kiến bổ sung hỗ trợ HTTP SSE, mở rộng khả năng kết nối với các server từ xa.

Kết luận

Model Context Protocol, khởi nguồn từ Anthropic, là một bước tiến lớn trong việc kết nối các mô hình AI với thế giới thực. Với thiết kế mở và chuẩn hóa, MCP không chỉ cải thiện hiệu suất mà còn thúc đẩy sự sáng tạo trong phát triển ứng dụng AI. Đối với cộng đồng lập trình viên Việt Nam, việc nắm bắt MCP có thể là cơ hội để xây dựng những giải pháp AI tiên tiến, tận dụng dữ liệu thời gian thực một cách hiệu quả.

- Special Purpose Entity (SPE)- Các Tổ Chức Được Thành Lập Với Mục Đích Đặc Biệt

- Khi AI Không Chỉ "Nói Suông": Bước Sang Kỷ Nguyên Của Những Trợ Lý Biết Tư Duy

- Báo cáo Toàn diện về Hình học Riemannian: Khuôn khổ Toán học Tiên tiến trong Giải mã Tín hiệu Sóng não

- Học Từ Vựng Tiếng Anh Qua Chủ Đề Mua Sắm

- XU HƯỚNG CÔNG NGHỆ AR ĐỐI VỚI GIỚI TRẺ